Hallo zusammen,

ich hänge mich mal einfach an diesen Thread dran. Ich bin der Entwickler von mAirList, also der Radioautomation, die weiter oben schon erwähnt und gezeigt wurde. Auch wenn ich heute hauptberuflich meinen Lebensunterhalt damit bestreite, so stammt die Software ursprünglich aus der nichtkommerziellen Radiolandschaft (ist beim Campusradio eldoradio* in Dortmund entstanden), und wird heute von vielen Sendern dieser Art benutzt (auch Bürgerradio usw.). Und als alter Campusradiomacher bin ich natürlich immer auf der Suche nach coolen neuen Ideen und Tools. Auf baresip hatte ich schon länger mal ein Auge geworfen, war mir aber alles etwas zu unübersichtlich damit zu hantieren. Studio-Link finde ich großartig, weil es die richtige “Verpackung” um baresip herum macht, damit das ganze auch benutzbar wird. Insofern schonmal Daumen hoch!

Dass Studio-Link in einem echten Radiostudio verwendet wird, finde ich alles andere als abwegig. Im Grunde ist Studio-Link doch genau das, was von diversen Herstellern als “Hardware-Codec” für teures Geld verkauft wird: Ein SIP-Stack mit einem Opus-Codec.

Natürlich sind in einem Radiostudio die Gegebenheiten ein wenig komplizierter als bei jemandem, der nur mal zwischendurch zuhause einen Podcast produziert. Ein Mischpult mit der Möglichkeit, mal eben einen N-1 zu bauen, ist immer vorhanden. Dafür allerdings hat man oft SEHR VIELE Soundkarten-Ein-/Ausgänge, oder virtuelle AoIP-Soundkarten (Dante, Livewire, Ravenna, …), die dann mal eben 24 oder 32 Stereokanäle bieten.

Deswegen wäre mein allergrößter Wunsch an eine zukünftige Version von Studio-Link, dass man die Soundkarten gezielt auswählen kann. Ich habe das schonmal händisch über die baresip-config versucht, bin aber bislang kläglich gescheitert. (Vielleicht kann mal jemand erläutern, wie man das “winwave,nil” anpassen muss, wenn man gezielt eine bestimmte Karte ansprechen will.)

Die Standard-Soundkarte von Windows umzustellen ist auf Studio-PCs ein No-Go. Das würde nämlich bedeuten, dass sämliche Soundausgabe von den Standardanwendungen (Webbrowser, Mediaplayer, auch “versehentlich” geöffnet) plötzlich über den Eingangskanal von Studio-Link laufen würden, was absolut nicht erwünscht ist.

Das ist leider etwas, was auch die Entwickler von Chrome/WebRTC noch nicht erkannt haben. Da ist seit Jahren ein Ticket mit einem Feature Request offen, um auch die Ausgabesoundkarte wählen zu können. Irgendwie scheinen die gedanklich alle in ihrer USB-Headset-Welt zu leben…

Mit der Soundkartenauswahl wäre es dann ohne weiteres möglich, Studio-Link als einfaches Tool für die Verbindung zwischen zwei Radiostudios, oder zwischen Studio und Interviewpartner, einzusetzen.

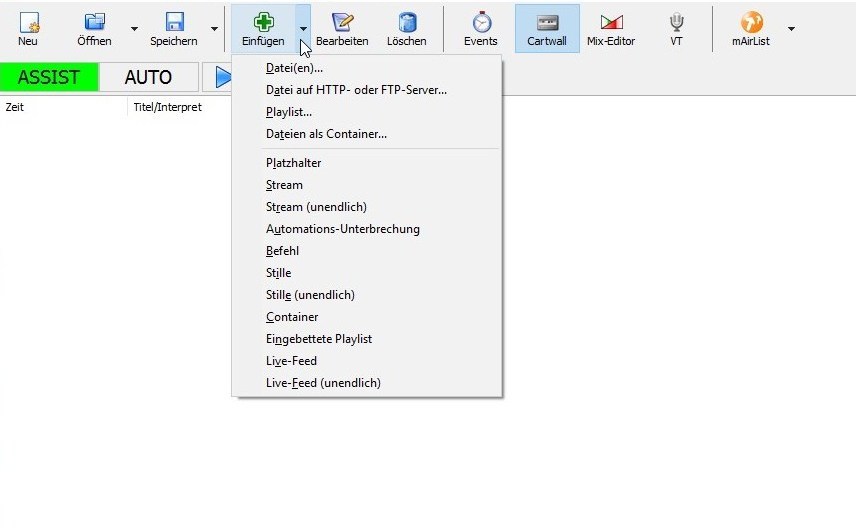

Das andere Thema, das worka angesprochen hat, ist das automatische Einbinden von Anrufen in das Playout. Viele User haben einen Rechner stehen, auf dem ein mAirList 24/7 irgendwelche eingeplanten Audios vor sich hin spielt. Die Anforderung wäre nun, dass jemand von irgendwo anders das Studio-Link auf diesem Sende-PC anrufen kann, und das Signal ins laufende Programm eingespeist wird. Oder andersherum mAirList via Studio-Link zu einer bestimmten Zeit irgendwo anruft.

Dazu sind zwei Dinge notwendig:

- Man braucht eine API zwischen mAirList und Studio-Link bzw. baresip, um Anrufe tätigen und entgegennehmen zu können.

- Man muss das Audio irgendwie von Studio-Link in mAirList und zurück schleifen.

Punkt 2 ist der interessante. Denn hier geht es nicht mehr um die “dumme” Audioausgabe auf irgendeinem wave-Device. Sondern ich möchte das Audio tatsächlich, über eine Pipe oder wie auch immer, in den mAirList-Prozess bekommen, um es dort weiterzuverarbeiten (nutze die BASS.DLL). Tatsächlich ist es so, dass viele Leute diesen Playout-Server auf einem gemieteten Blech bei irgendeinem Provider laufen haben, wo es keine physikalischen Soundkarten gibt. Und solche Lösungen wie Virtual Audio Cable sind erfahrungsgemäß auch eher zu meiden.

Insofern wäre das Nonplusultra ein Audiotreiber für baresip, der die PCM-Daten nicht an eine Soundkarte schickt sondern über Pipes an andere Anwendungen zur Verfügung stellen kann. Da stecke ich jetzt aber echt zuwenig im Thema (baresip-Source) drin um sagen zu können, ob sowas realistisch wäre.

Dies erstmal als kleiner Überblick, wie meine Sicht der Dinge auf das Thema ist.

Viele Grüße

Torben

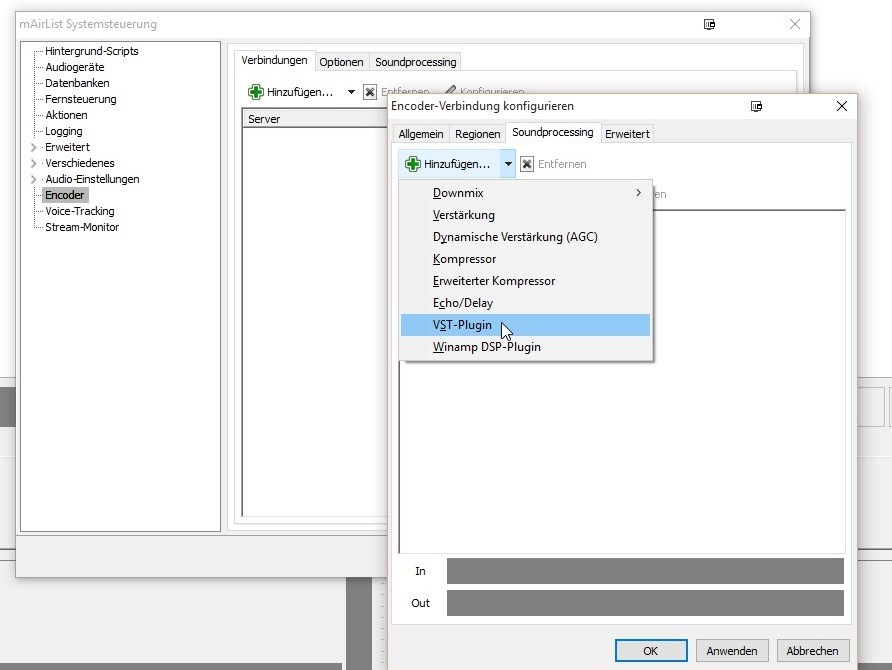

Edit: Noch ein Nachtrag: Für die Sache mit dem Audio-Austausch könnte man natürlich die Nutzung des VST-Plugins in Erwägung ziehen. Ich hatte das mal ausprobiert, 32-bit-Version, mit dem bass_vst-Wrapper. Die ist mir aber abgeschmiert in dem Moment, wo ich das erste Sample rübergeschickt habe. Falls wir das mal debuggen sollen, sagt bescheid.

Hinzufügen kann man nämlich nur dies.

Hinzufügen kann man nämlich nur dies.